Die Attraktivität generativer KI im Learning & Development ist offensichtlich. Sie kann Materialien entwerfen, umformulieren, zusammenfassen, übersetzen und erweitern – in einer Geschwindigkeit, mit der kein menschliches Team mithalten kann. Für Einkaufsteams und überlastete Akademien ist dieses Versprechen verführerisch: mehr Module, mehr Handouts, mehr Micro-Units, mehr Sprachversionen, in kürzerer Zeit. Doch im Bildungsbereich hat nie primär ein Mangel an Inhalten geherrscht. Das eigentliche Problem sind schlecht getimte Unterstützung, ungleiche Vorkenntnisse, kognitive Überlastung und die anhaltende Lücke zwischen Kontakt mit dem Stoff und tatsächlicher Beherrschung. Die aktuelle OECD-Arbeit zu generativer KI in der Bildung macht diese Unterscheidung deutlich: KI kann Lernen unterstützen, wenn sie mit klarer pädagogischer Absicht eingesetzt wird; werden Aufgaben jedoch ohne didaktische Führung ausgelagert, kann sich zwar die Leistung verbessern, ohne dass entsprechende Lerngewinne entstehen. Die UNESCO formuliert das Governance-Problem ähnlich klar: Die Verbreitung öffentlicher GenAI-Tools schreitet schneller voran als Regulierung und schneller als die Fähigkeit von Institutionen, diese Werkzeuge verantwortungsvoll zu prüfen.

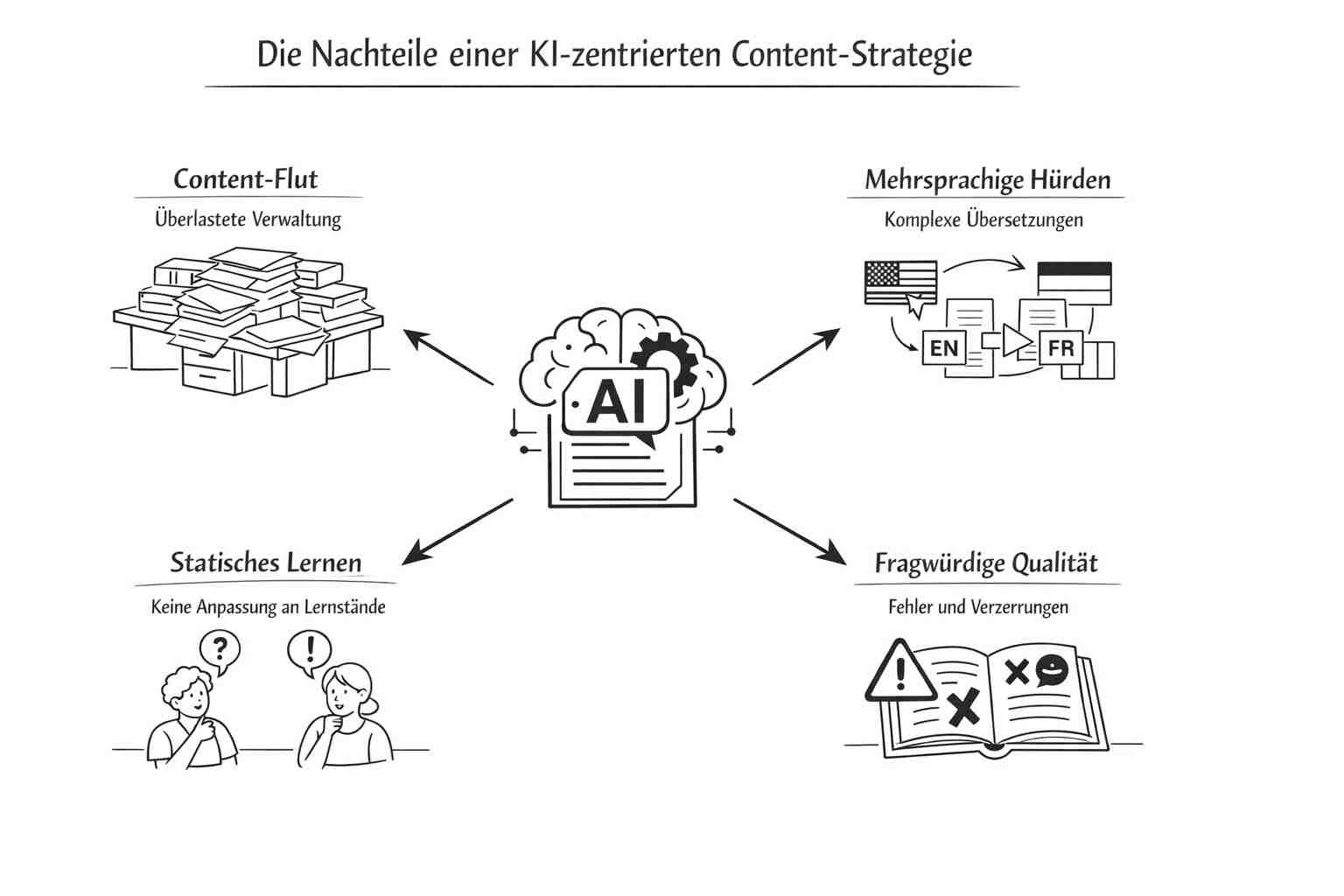

Genau deshalb lautet die entscheidende Frage nicht, ob KI Lerninhalte erzeugen kann. Das kann sie offenkundig. Die eigentliche Frage ist, ob eine Organisation ihre Bildungsstrategie auf genau diese Fähigkeit aufbauen sollte. In den meisten Fällen lautet die Antwort: nein. Eine contentzentrierte KI-Strategie verwechselt Output mit Pädagogik und Effizienz mit Wirksamkeit. Sie verschafft Institutionen mehr Assets, die verwaltet werden müssen, löst aber kaum das schwierigere und teurere Problem, Lernenden mit sehr unterschiedlichen Voraussetzungen tatsächlich beim Fortschritt zu helfen.

1. Die verborgene Ökonomie des „unendlichen Contents“

Statische Lernmaterialien wirken im Moment ihrer Erstellung günstig – und überall danach teuer. Sobald ein Team beginnt, mithilfe von KI aus einer Quelle zehn Varianten, drei Schwierigkeitsstufen, vier Quiz-Sets und mehrere Sprachversionen zu erzeugen, hat es die Komplexität nicht reduziert. Es hat die Komplexität von der Autorenschaft in Governance, Review, Pflege und Versionskontrolle verlagert. Die eigenen Lokalisierungsleitfäden von Articulate sind hier aufschlussreich. Dort werden Review-Prozesse, Qualitätssicherung, Stakeholder-Management, Dateiverwaltung und Update-Zyklen als eigenständige operative Aufgaben behandelt – nicht als kleine Nebensachen. Die Hinweise zum Aktualisieren lokalisierter Kurse benennen das Problem direkt: Wenn sich der Quellinhalt ändert, müssen diese Änderungen sauber und synchron in alle Sprachversionen übertragen werden. Das ist kein Randthema. Das ist das Betriebsmodell.

Eine ähnliche Diagnose findet sich in den praxisnahen Beiträgen von Tarsus zum Thema Microlearning. Im Artikel Microlearning ist nicht zu klein gedacht – sondern zu oft falsch gebaut geht es nicht darum, dass Einheiten zu kurz wären, sondern darum, dass sie sich häufig zu Sammlungen aus Karten, Quizzen und Videos verfestigen, die Klicks, Suchaufwand und Wechsel zwischen Formaten erhöhen, ohne das Lernen verlässlich zu verbessern. Die zentrale Beobachtung des Artikels verdient auch jenseits des Produktkontexts Beachtung: Kleine Content-Bausteine skalieren schlecht, wenn sie in vielen Varianten gepflegt und für Lernende mit in der Praxis stark auseinanderlaufenden Bedürfnissen relevant gehalten werden müssen.

Was von außen wie Überfluss aussieht, wird intern oft zu administrativer Trägheit. Jedes neu KI-generierte Asset schafft künftige Verpflichtungen: Metadaten, Freigaben, Zuständigkeiten, Regeln zur Ausmusterung, rechtliche Prüfungen, Sprachreviews, Accessibility-Checks, Update-Prozesse und Support. In diesem Sinne ist „mehr Content“ kein neutraler Effekt. Er wird zur Verbindlichkeit, wenn nicht jedes Asset eine klare didaktische Funktion und einen belastbaren Pflegeplan besitzt.

2. Statische Materialien lösen das Problem heterogener Lernvoraussetzungen nicht

Das tiefere Problem ist pädagogischer, nicht operativer Natur. Lernende starten nicht mit denselben Voraussetzungen, und sie geraten auch nicht an denselben Stellen ins Stocken. Eine der klarsten Erkenntnisse aus der Forschung zu Heterogenität im Unterricht ist zugleich eine der unspektakulärsten: Adaptive Instruktion ist schwierig, weil Lehrkräfte und Systeme gleichzeitig Vorwissen, Lernbedarfe, aktuellen Fortschritt und Lernumgebung berücksichtigen müssen. Ein statischer Kurs hingegen kann Schwierigkeiten nur antizipieren. Er kann nicht diagnostizieren, was genau diese eine lernende Person in diesem Moment missversteht.

Der Tarsus-Artikel zu Articulate-Kursen bringt diese Begrenzung praktisch auf den Punkt. Er argumentiert, dass selbst gut gebaute Kurse standardisierte Angebote bleiben: Lernende bleiben an unterschiedlichen Stellen hängen, brauchen unterschiedliche Erklärungen und lernen in unterschiedlichem Tempo – während der Kurs selbst für alle weitgehend gleich bleibt. Dasselbe Motiv erscheint in der Fallstudie zum BWV Nordbayern-Thüringen: Das Problem wird dort nicht als Qualitätsmangel der Lehre beschrieben, sondern als Skalierungsproblem, das aus heterogenen Gruppen unter Zeit- und Personaldruck entsteht. Das sind keine kontrollierten Studien und sollten auch nicht als solche gelesen werden. Sie sind aber wertvolle Feldbeschreibungen einer realen didaktischen Begrenzung.

Die unabhängige Forschung zeigt in dieselbe Richtung. Ein Scoping Review aus dem Jahr 2024 zu personalisiertem adaptivem Lernen mit 69 Studien stellte fest, dass 41 Studien, also 59 Prozent, verbesserte akademische Leistungen berichteten, während 25 Studien, also 36 Prozent, eine höhere Lernbeteiligung feststellten. Die OECD-Analyse von 2026 geht in ihrer Unterscheidung zwischen allgemeinen GenAI-Tools und lernorientierten Systemen noch weiter: Erstere können die Qualität studentischer Antworten im Üben verbessern, ohne dass Prüfungsleistungen steigen; sie können sich sogar verschlechtern. Spezialisierte Systeme, die mit pädagogischer Absicht entwickelt wurden, zeigen dagegen mehr Potenzial für tatsächliche Lernfortschritte. Das ist die entscheidende Trennlinie. Bildung profitiert nicht von mehr Text im Regal, sondern von besserer Anpassung im Vollzug des Lernens.

3. Mehrsprachige Skalierung vervielfacht zuerst die Pflege, nicht den Wert

Im mehrsprachigen Kontext wird die Schwäche einer reinen Content-Strategie besonders sichtbar. Einen Kurs zu übersetzen bedeutet selten nur Übersetzung. Es bedeutet Terminologiepflege, Review-Workflows, Stakeholder-Abstimmung, Qualitätssicherung, Dateimanagement und synchronisierte Aktualisierungen über die Zeit. Die Lokalisierungsdokumentation von Articulate beschreibt faktisch eine ganze Disziplin rund um genau diese Aufgaben. Allein das sollte Teams vorsichtig machen, die glauben, KI-generierter mehrsprachiger Content werde sich nach seiner Erstellung weitgehend selbst verwalten.

Daraus ergibt sich eine zweite Konsequenz. Wenn KI-Autorenschaft außerhalb des Lernsystems oder außerhalb der Authoring-Umgebung stattfindet, holen sich Teams manuelle Arbeit oft auf anderem Wege zurück: durch Copy-and-paste, Umformatierung, Import-/Export-Handgriffe, Review-Übergaben und doppelte Versionspflege über mehrere Tools hinweg. Selbst dort, wo KI Entwurfszeit spart, können fragmentierte Workflows einen großen Teil dieses Vorteils wieder aufzehren. Der wachsende Fokus kommerzieller Authoring-Ökosysteme auf integrierte Lokalisierung und synchronisierte Updates ist selbst ein Indiz dafür, wo die eigentlichen Kosten liegen: in Reibung der Pflege, nicht nur in der ersten Erstellung.

Anders gesagt: Mehrsprachige Skalierung erweitert nicht einfach die Reichweite. Sie verstärkt auch die Folgen jedes schwachen Ursprungssatzes, jeder Policy-Änderung, jeder fachlichen Korrektur und jedes didaktischen Fehlers. KI beschleunigt die Produktion genau dieser Verbindlichkeiten, sofern der Workflow nicht darauf ausgelegt ist, sie zu steuern.

4. Bildungsinhalte im großen Maßstab zu generieren vervielfacht auch epistemische Risiken

Es gibt einen zweiten Grund, eine contentgetriebene KI-Strategie kritisch zu sehen: Das Zuverlässigkeitsproblem verschwindet nicht, nur weil Inhalte glatt und professionell klingen. Die UNESCO beginnt ihre Leitlinien zu GenAI in Bildung und Forschung mit einer Governance-Sorge: Öffentliche Werkzeuge verbreiten sich schneller als Regulierung, wodurch Institutionen nicht ausreichend vorbereitet sind, sie zu validieren, und Nutzende unzureichend geschützt bleiben. Eine weitere UNESCO-Veröffentlichung weist darauf hin, dass generative KI neue Schadensformen mit sich bringt, darunter Halluzinationen, unbeabsichtigte Verzerrungen und realistisch wirkende Falschdarstellungen. Das ist im Bildungsbereich besonders relevant, weil Sicherheit im Ton und sprachliche Flüssigkeit leicht mit Wahrheit verwechselt werden.

Bias ist dabei kein hypothetisches Problem. Die UNESCO berichtete 2024, dass ein Modell Frauen viermal so häufig in häuslichen Rollen beschrieb wie Männer, und fand eindeutige Hinweise auf Vorurteile gegenüber Frauen in den von den untersuchten Sprachmodellen generierten Inhalten. Wenn solche Verzerrungen bereits in gewöhnlichen narrativen Prompts auftreten, können sie ebenso in Bildungsbeispielen, Arbeitsszenarien und Prüfungsaufgaben auftauchen. Das Skalieren statischer KI-Inhalte skaliert deshalb nicht nur Effizienz. Es skaliert auch subtilen Fehler und stereotype Verzerrung.

Die Daten der OECD legen nahe, dass die Nutzung der Absicherung bereits vorausläuft. Im Jahr 2024 gaben 37 Prozent der Lehrkräfte in der Sekundarstufe I an, KI für ihre Arbeit zu nutzen; 57 Prozent stimmten zu, dass KI beim Schreiben oder Verbessern von Unterrichtsplanungen hilft, und 72 Prozent waren der Ansicht, dass KI akademische Integrität gefährden kann, indem Lernende fremde Arbeit als eigene ausgeben. Diese Zahlen sprechen nicht gegen den Einsatz von KI. Sie zeigen, dass institutionelle Praxis bereits weit verbreitet ist, während Vertrauen, Regelwerke und Prüfungsdesign noch im Fluss sind.

5. Der überzeugendere Einsatz von KI beginnt nicht bei mehr Content, sondern bei besserer Unterstützung

Nichts an der Kritik an statischen KI-Inhalten bedeutet, dass KI in der Bildung keinen sinnvollen Platz hätte. Der entscheidende Unterschied liegt nicht zwischen „mit KI“ und „ohne KI“, sondern zwischen zwei sehr verschiedenen Einsatzlogiken. Die eine produziert schneller mehr Material. Die andere verbessert den Lernprozess selbst. Genau in dieser zweiten Logik sieht die OECD das größere Potenzial: Zweckgebundene, für Lernprozesse entwickelte KI-Systeme zeigen mehr pädagogische Substanz als allgemeine GenAI-Werkzeuge, und adaptive KI kann Instruktion und Feedback an unterschiedliche Voraussetzungen, Lernstile und Fähigkeitsniveaus anpassen. Zugleich warnt die OECD davor, kognitive Anstrengung durch KI zu ersetzen. Der Maßstab ist also nicht Bequemlichkeit, sondern Lernwirksamkeit.

Eine überzeugende Zielarchitektur sähe deshalb nicht wie eine weitere Content-Fabrik aus, sondern wie ein didaktisch steuerbarer KI-Lerncoach oder KI-Trainer. Ein solches System würde nicht primär neue Assets erzeugen, sondern auf vorhandenen Unterlagen einer Organisation aufbauen und daraus situative Unterstützung im Dialog ableiten: Erklärungen, Rückfragen, Übungsimpulse, Wissenschecks, Transferaufgaben und Wiederholungen — jeweils passend zum tatsächlichen Lernstand. Entscheidend wäre dabei die Steuerbarkeit: Lerntempo, Schwierigkeitsgrad, DQR-Niveaus und IHK-Taxonomien müssten konfigurierbar sein, damit die KI nicht nur antwortet, sondern entlang eines klaren Kompetenzmodells trainiert. Ebenso wichtig wäre sauberes Fortschrittstracking bis ins LMS, einschließlich dokumentierbarer Nachweise für regulierte Kontexte wie AZAV. Erst diese Verbindung aus interner Wissensbasis, adaptivem Dialog, didaktischer Konfiguration und nachvollziehbarer Dokumentation macht aus KI ein Bildungssystem statt nur ein Textsystem.

Wer die Grenzen klassischen, vorproduzierten Microlearnings noch genauer einordnen möchte, findet dazu eine treffende praxisnahe Vertiefung in diesem Beitrag.

Fazit

Die entscheidende strategische Frage lautet daher nicht, ob KI Inhalte schneller produzieren kann. Das kann sie. Die wichtigere Frage ist, ob eine Bildungseinrichtung mit dieser Geschwindigkeit auch ein didaktisch tragfähiges Modell gewinnt. In den meisten Fällen lautet die Antwort: nur dann, wenn KI nicht als Produktionsmaschine für statische Lernobjekte verstanden wird, sondern als steuerbare Infrastruktur für Erklären, Üben, Prüfen und Dokumentieren. Die OECD formuliert diesen Punkt sehr klar: Vielversprechend sind vor allem Systeme mit expliziter pädagogischer Zielsetzung, die Lernprozesse unterstützen, statt bloß Output zu vervielfachen.

Die beste Lösung ist deshalb weder eine immer größere Content-Bibliothek noch ein ungebundener Allzweck-Chatbot neben dem Kurs. Am überzeugendsten ist ein KI-Lerncoach, der auf den eigenen Materialien einer Organisation basiert, entlang von Taxonomien und Niveaustufen gesteuert werden kann, individuelle Lernschritte im Dialog erzeugt und Fortschritt revisionsfähig nachhält. Dann wird KI nicht zum Generator von Material, sondern zum operativen Bestandteil von Aus-, Fort- und Weiterbildung. Und erst in dieser Form beginnt sie, das eigentliche Problem zu lösen: nicht den Mangel an Content, sondern den Mangel an passender Unterstützung im richtigen Moment.